SEO (search engine optimization) décrit l'ensemble des pratiques qui permet d'améliorer la position de son site web dans les différents moteurs de recherche.

Avant de commencer, je tiens à préciser que le référencement est un domaine à part entière. Le but ici est de vous donner un aperçu des premières optimisations que vous pouvez faire pour améliorer votre positionnement. Si vous souhaitez aller plus loin, il faudra alors chercher un site spécialisé SEO.

Référencement naturel ?

Avant de commencer, mettons-nous au point sur la terminologie que l'on va utiliser. On parlera dans la suite de cet article de référencement naturel (SEO) par opposition à l'achat de positionnement (SEA).

Le SEA, Search Engine Advertising, consiste à acheter des mots clef pour être mieux positionné. Le seul moyen de se positionner sur cet espace est d'enchérir sur des mots clef spécifique (campagnes adwords dans le cas de Google).

Le SEO, Search Engine Optimization, à l'opposé, consiste à améliorer son positionnement par des optimisations sur son site afin de le rendre plus pertinent. Il n'est pas possible de payer pour être mieux placé qu'un concurrent, tout le monde a, au départ, les mêmes chances.

Le SEM, Search Engine Marketing, consiste à améliorer la visibilité de son site par le SEO et/ou le SEA.

Enfin même si on parlera souvent de référencement, être référencé sur les moteurs de recherche n'a rien de bien complexe (pour google il suffit de se rendre sur google.fr/addurl). En revanche, être bien positioné est une toute autre histoire.

L'obtention d'une bonne position est le nerf de la guerre, si votre site n'est pas visible dans les premières pages il n'est quasiment pas trouvable par les utilisateurs. Donc lorsque l'on parlera de référencement on parlera en réalité de l'amélioration de son positionnement.

Les outils

On ne va pas se le cacher Google reste le roi des recherches, c'est encore plus vrai en France. Donc la plupart des optimisations/outils que l'on va utiliser vont se concentrer sur Google mais affecteront aussi les autres moteurs de recherche.

Google Webmaster tool

Le premier outil incontournable pour suivre son positionnement est Google Webmaster Tool. Cet outil vous permet d'obtenir un rapport de santé de l'indexation de votre site. On y trouverra notamment :

- Un rapport sur le passage des robots Google sur votre site. La donnée intéréssante ici est le nombre de pages visitées et le temps d'exploration.

- Des conseils d'améliorations et l'affichage des erreurs d'explorations (erreurs 404 trop fréquente par exemple dûes à des liens morts)

- La gestion des sitemaps

Cet outil est incontournable et je vous conseille d'y ajouter votre site dès le démarrage afin de détecter les erreurs le plus rapidement possible. Pour valider votre site, Google vous demandera de placer un fichier html particulier (histoire de s'assurer que vous êtes bien le propriétaire du site en question).

Google analytics

Google analytics quant à lui vous permet d'analyser votre traffic et de comprendre un peu mieux les habitudes de vos utilisateurs. Il permet à la fois de comprendre comment les gens sont arrivés sur le site mais aussi les pages les plus visitées (et donc celle sur lesquelles on travaillera notre référencement).

Attention ! Depuis le passage des moteurs de recherche au SSL, les outils de trackings ne peuvent plus connaitre les mots clefs qui ont menés à votre site. Du coup on sera contraint d'analyser les pages d'arrivées des visiteurs, qui donnent beaucoup moins d'informations.

Les "spiders"

Avant de parler de réelles optimisations nous allons faire un point sur le fonctionnement d'un moteur de recherche. Ceci permettra de mieux comprendre l'objectifs des améliorations que l'on pourra faire.

Pour proposer des résultats de recherche pertinents, les moteurs de recherche vont commencer par indexer les sites. Pour cela, des centaines de milliers de robots (appellés spiders) vont crawler (parcourir) votre site afin d'en analyser le contenu et ainsi savoir comment le positionner dans son index. Quelques paramètres vont influencer la navigation de nos petits amis les robots :

- La vitesse de chargement de vos pages a une influence direct sur la capacité d'indexation de votre site. Si les pages mettent 2 secondes à se charger, les robots vont alors perdre beaucoup de temps lors de l'exploration et indexeront beaucoup moins de pages lors de leur passage.

- Le maillage de votre site doit être logique. Les robots arrivent par une page et doivent être capable d'atteindre les autres pages du site le plus rapidement possible (sans trop de profondeur, si il faut parcourir 70 liens pour trouver une page clef ce n'est pas bon)

Le contenu est roi

On l'aura compris les moteurs de recherche ne sont que des programmes qui analysent le contenu de notre site, c'est donc bel est bien le contenu qui est la clef du positionnement.

La balise title

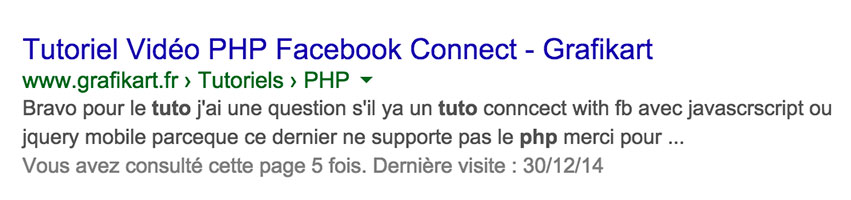

La balise <title> permet de donner un titre à notre page. Elle doit décrire au mieux votre page et surtout être UNIQUE. En effet, pour un moteur de recherche 2 pages ne doivent pas avoir le même titre.

- On évitera par exemple, de mettre le même titre à toutes nos pages.

- Le titre doit décrire votre page en contenant des mots clef importants.

- Le titre doit être synthétique

- Le titre doit être pertinent, et ne pas simplement être une suite de mots clef.

Le titre est important car en plus d'être utilisé dans l'algorithme de classement, il permet de guider les utilisateur en étant afficher dans le listing des résultats donc ne le négligez pas !

La meta description

Cette balise <meta name="description" value="?????"> permet de spécifier une description (courte) de votre page. Elle avait autrefois une importance capitale dans l'algorithme, mais est maintenant complètement ignorée. En revanche, elle est encore utilisée dans l'affichage des résultats de recherche. Mais si elle diffère trop du contexte de recherche, les moteurs peuvent l'ignorer pour prélever un texte dans votre page suivant les mots clef demandés par l'utilisateur.

h1, h2, h3 sont sur un bateau

Les robots n'ont pas d'yeux (pour le moment en tout cas :D) et analyse donc la syntaxe HTML. Il est important que le contenu soit hierarchisé correctement.

- On conseillera souvent de ne mettre qu'un h1 par page (on peut déroger à cette règle dans certains cas)

- les h2, h3, h4 et h5 doivent être utilisés logiquement (évitez donc de les utiliser dans vos styles CSS, puisque vous pourriez être tenté de les utiliser à mauvais escient)

- Si on désactive le CSS de votre site il faut que le contenu reste lisible et la hiérarchie compréhensible.

- Un mot clef placé dans un h1 aura plus d'importance qu'un mot clef dans un h2 ou un simple paragraphe.

La densité de mots clef

La densité d'un mot clef représente le nombre de fois qu'un mot clef apparait dans un texte. Cette densité peut être pondérée par la position du mot clef dans le code (un mot clef dans un h1 aura plus d'importance que dans un simple p). Même si c'est une technique à la mode, il faut savoir que répéter volontairement un mot clef dans un texte est pénalisé par Google (au delà d'un certain % Google considère cela comme du spam). Le but premier d'un moteur de recherche est de donner des résultats pertinents pour un humain (et non pas une machine) donc il faudra essayer de placer les mots clefs de manière intelligente. Si vous commencez à faire des phrases qui n'ont aucun sens, juste pour placer des mots clef, vous êtes sur la mauvaise voie.

Le maillage de liens

Il est important d'essayer de faire des liens internes au sein de vos contenus. Essayez d'imaginer une toile reliant vos différentes pages par des liens, plus cette toile est dense, plus il est facile d'atteindre une page.

- Si par exemple je fais un article sur facebook qui parle de facebook connect, je vais mettre un lien vers mon tutoriel Facebook connect. Ceci permettra de mettre en relation ces 2 pages et de faire comprendre aux moteurs qu'il existe un rapport entre ces 2 pages.

- Si on crée un blog ou un commerce par exemple, mettre en place un système d'articles relatifs peut être un très bon moyen de densifier le maillage sans trop d'effort.

Comme le reste, il ne faut pas en abuser, ne mettez des liens internes que lorsque cela est justifié. Ne commencez surtout pas à mettre un lien à chaque mot clef car cela pourra être considéré comme de l'abus par les moteurs, en plus d'être très pénible pour vos utilisateurs.

Les URLs

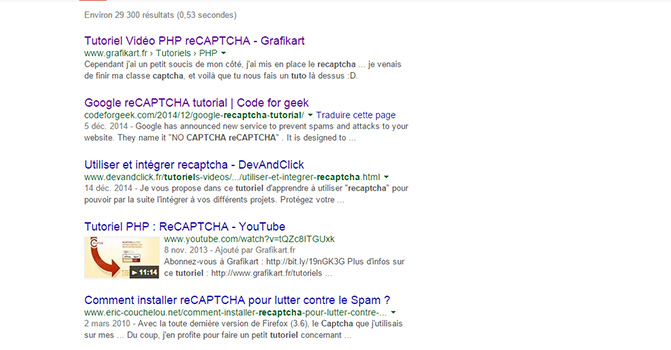

Les urls de votre site doivent avoir une structure logique et contenir des mots clef importants. Même si l'effet est parfois contesté, il semblerait bien que les moteurs de recherche prennent en compte ces-derniers.

- L'URL ne doit pas être trop longue

- On essaiera d'éviter les URLs dynamiques au possible (du genre ?pid=23)

- Un mot est plus clair qu'un chiffre (/category/2 contre /category/php)

- Eviter une profondeur trop importante et garder une structure logique. Il faut que les sous dossiers dans vos URLs soient logiques

/articlespermet de voir tous les articles/articles/cuisinetous les articles de cuisine/articles/cuisine/poele-a-frire

- Les mots doivent être séparé par de tirets -

-

Les URLs doivent être insensible à la casse, idéalement on met tous les mots en minuscule.

Page Rank vs Trust Rank

Il y a encore quelques années le Page Rank constituait un indice très important dans le calcul du positionnement. Basiquement, plus votre site avait de backlinks (sites externe menant à votre site) plus il était jugé comme important. On avait même l'habitude de créer des sites satellites pour booster artificiellement cet indice et monter plus rapidement.

Cet indice a été repensé par Google au profit d'un Trust Rank qui va chercher à qualifier les liens menant à votre site pour éviter les abus. Tous les backlinks n'ont donc plus la même valeur et cela ne sert plus à rien de faire de l'échange de liens à tout va. Pour établir le trust rank d'un site Google va se baser sur plusieurs informations.

- L'historique de votre domaine, un site présent depuis plusieurs années sera plus crédible qu'un site qui vient juste d'apparaitre. Si votre domaine a été utilisé pour du spam dans le passé ça peut aussi vous desservir.

- La qualité des liens externes, si le site contient des tonnes de liens externes sur des thèmes trop variés il n'aura pas un bon trust rank et peut être considéré comme un site de spam, un lien provenant de ce type de site n'a aucune valeur.

- Le contenu, un contenu unique prouve à Google que votre site est un véritable site. Faire du duplicate content (copier le texte depuis une autre source) est très largement pénalisé. Google préfère toujours mettre en avant le contenu original (apparu en premier).

Lorsque l'on a un backlink le Trust Rank est donc pris en compte. Il vaut mieux avoir un lien vers votre site provenant d'une source de confiance, plutôt que 200 liens menant à vous depuis des sources plus que douteuses. Ne cherchez donc pas à faire des échanges de lien ou à copier le lien de votre site partout sans réfléchir.

Il est aussi important de noter que les moteurs sont capable d'identifier les liens pointant vers vous depuis les réseaux sociaux par contre il est difficile d'établir un ordre d'importance pour ce type de backlink par rapport aux sites classiques.

Robots.txt

Il est possible d'avoir un contrôle sur ce que va référencer les moteurs de recherche en plaçant un fichier robots.txt à la racine de notre site. Ce fichier n'a pas d'impact sur votre positionnement mais permet de donner des instructions au robots qui explorent votre domaine. On pourra par exemple les empécher de se rendre sur des dossiers spécifiques :

User-agent: Googlebot

Disallow: /tutoriels/demo/Cela permet de faire gagner du temps aux robots en leur évitant de se rendre sur des dossiers qui ne sont pas utils. Mais faites attentions à ne pas écrire de règle trop large du style

Disallow: /Au risque de voir tout votre site disparaitre.

Si vous souhaitez avoir plus d'exemples d'User-agent vous pouvez trouver plus d'informations sur robots-txt.com.

Sitemap

Un sitemap est un fichier XML qui va répertorier les pages de votre site et qui va permettre de guider les robots dans leur exploration. Même si l'impact sur le positionnement est discutable cela permet un référencement plus rapide de certaines de vos pages.

On pourra préciser ou se trouve notre sitemap depuis Google Webmaster Tool ou depuis le fichier robots.txt

Sitemap: http://www.mon-domaine.fr/sitemap.xmlVous pouvez aussi créer d'autres types de sitemaps comme notamment les sitemaps vidéos. En effet les vidéos ne sont pas représentées de la même façon que les autres résultats et contiennent une miniature qui permet de les différencier des autres résultats.

Si vous souhaitez plus d'informations sur ce type de sitemaps vous pouvez obtenir plus d'informations sur le support google.

Conclusion

Le but des moteurs de recherche, et surtout de google, est de donner les résultats les plus pertinents possibles (c'est d'ailleurs ce qui a fait son succès). Donc lorsque vous concevez votre site et votre contenu, il ne faut pas vous focaliser seulement sur les moteurs de recherches mais plutôt sur les utilisateurs.

On l'a vu au fil des mises à jours de l'algoritheme de google, toutes tentatives d'amélioration artificielle du référencement se sont au final avérées pénalisantes.